Pourquoi 80 % des projets d'agents IA échouent

Agents IA en production : 80 % échouent selon RAND. Les 5 causes principales et les solutions concrètes pour éviter l'échec de vos projets d'IA agentique.

80 % des projets d’agents IA n’atteignent jamais la production. C’est le chiffre central de l’étude RAND Corporation, basée sur des entretiens avec 65 data scientists expérimentés, soit le double du taux d’échec des projets IT classiques. Et les agents IA spécifiquement s’en sortent encore moins bien : 88 % des pilotes ne dépassent jamais le stade du POC.

J’ai analysé les données de RAND, Gartner, IDC et les retours terrain de r/ArtificialIntelligence pour identifier les cinq causes principales de ces échecs. Voici ce que j’ai trouvé, et surtout, ce que font les 12 % qui réussissent.

Le constat : des chiffres qui ne mentent pas

Les statistiques convergent, quelle que soit la source.

| Source | Chiffre clé | Année |

|---|---|---|

| RAND Corporation | 80 % des projets IA échouent avant la production | 2024 |

| IDC / Lenovo | 88 % des POC IA ne passent jamais à l’échelle | 2025 |

| S&P Global | 42 % des entreprises ont abandonné la majorité de leurs initiatives IA (vs 17 % en 2024) | 2025 |

| Omdia | Seules 10 % des entreprises dépassent 40 % de taux de réussite | 2025 |

| Gartner | 40 %+ des projets d’IA agentique seront annulés d’ici 2027 | 2025 |

Le plus frappant : l’enquête S&P Global montre que le taux d’abandon a plus que doublé en un an. Les entreprises ne se contentent plus d’échouer silencieusement - elles arrêtent activement les frais.

Et ce problème ne touche pas que les petites structures. En mars 2026, un agent IA interne chez Meta, déployé pour aider les ingénieurs à analyser des questions techniques, a publié de manière autonome une réponse sur un forum interne sans approbation, exposant des données sensibles. L’incident a été classé « Sev 1 » par Meta. Selon le rapport HiddenLayer 2026, les agents autonomes représentent désormais plus d’une brèche IA sur huit dans les entreprises.

Cause 1 : l’absence de stratégie data et de gouvernance

La première cause d’échec n’est pas technique. Elle est organisationnelle.

Selon Gartner, les organisations abandonneront 60 % de leurs projets IA non soutenus par des données prêtes pour l’IA d’ici 2026. Les entreprises connectent un LLM à leurs bases de données sans avoir fait le travail de préparation en amont : nettoyage, structuration, normalisation.

Steven Dickens, CEO et analyste principal chez HyperFRAME Research, résume bien le problème : les organisations qui se précipitent négligent les étapes de gouvernance et de préparation des données.

Ce qui se passe concrètement

L’enquête Cleanlab de 2025, menée auprès de plus de 1 800 leaders en ingénierie logicielle, révèle que 60 à 70 % des organisations modifient entièrement leur infrastructure, leur LLM ou leur plateforme IA tous les trois mois. Ce rythme de changement est symptomatique d’un manque de fondations solides.

Les agents IA amplifient ce problème. Contrairement à une automatisation classique qui suit un chemin déterministe, un agent prend des décisions basées sur le contexte. Si ce contexte est pollué par des données incohérentes, l’agent prend des décisions incohérentes, mais avec confiance.

La solution

Avant de connecter un LLM, investissez dans trois chantiers :

- Audit des données : identifiez les sources, les doublons, les conflits entre référentiels

- Gouvernance formalisée : définissez qui est responsable de la qualité des données injectées dans l’agent

- Pipeline de données : construisez des flux de validation en temps réel, pas des imports manuels ponctuels

Les organisations qui appliquent une évaluation structurée des modes de défaillance avant le développement réduisent leur taux d’échec sous les 15 %.

Cause 2 : le syndrome du POC permanent

J’appelle ce phénomène l’« innovation theater » : les équipes construisent des démos convaincantes qui fonctionnent parfaitement en sandbox, mais qui ne survivent pas au contact avec l’environnement de production.

78 % des entreprises ont au moins un pilote d’agent IA en cours en mars 2026. Mais seulement 14 % ont réussi à déployer un agent à l’échelle organisationnelle. L’écart entre ces deux chiffres représente un cimetière de POC abandonnés.

Pourquoi les POC restent des POC

Le passage du POC à la production révèle des problèmes invisibles en environnement contrôlé :

- Les utilisateurs réels se comportent de manière imprévisible

- Les règles métier évoluent sans que l’agent soit mis à jour

- Les volumes de données en production sont 10 à 100 fois supérieurs à ceux du test

- Les contraintes de sécurité et de conformité n’apparaissent qu’en déploiement réel

Comme le souligne un rapport de Composio, cinq ingénieurs seniors passant trois mois sur des connecteurs personnalisés pour un pilote finalement abandonné représentent plus de 500 000 dollars en salaires.

La solution

Les 12 % qui réussissent le passage en production partagent trois pratiques :

- Périmètre étroit : un cas d’usage précis avec des résultats mesurables, pas un agent « qui fait tout »

- Équipe operations IA : nommée avant la sortie du pilote, responsable du monitoring, de l’évaluation et de la réponse aux incidents

- Infrastructure d’évaluation : les équipes qui réussissent investissent proportionnellement plus dans le monitoring et l’évaluation que dans la sélection du modèle ou le prompt engineering

Si vous avez déjà construit un premier agent IA avec n8n, vous savez que la vraie difficulté commence après la démo.

Cause 3 : les problèmes d’intégration technique

L’échec des agents IA en production vient rarement du LLM lui-même. Il vient de la couche d’intégration autour du modèle.

Le rapport Composio de 2025 identifie trois pièges techniques récurrents :

Le « Dumb RAG »

Injecter toutes les données dans une base vectorielle sans gestion fine du contexte. Le LLM se noie dans des informations non pertinentes, non structurées ou contradictoires, ce qui provoque des hallucinations. Pour comprendre comment structurer correctement cette approche, consultez le guide complet du RAG.

Les connecteurs fragiles

Pointer l’agent vers des API existantes sans normalisation des schémas, sans gestion des workflows non documentés et sans anticipation des limites de débit (rate limits). Un seul connecteur défaillant peut bloquer une chaîne entière d’actions.

La « polling tax »

Utiliser une architecture requête-réponse au lieu d’un système événementiel. Résultat : 95 % des appels API sont gaspillés et les quotas sont consommés sans valeur ajoutée.

La solution

Les équipes qui réussissent construisent ce que Composio appelle une « couche d’intégration agent-native », un système d’exploitation autour du LLM qui gère :

- La mémoire : quel contexte est pertinent pour quelle tâche

- Les entrées/sorties : normalisation des données entre systèmes

- Les permissions : qui peut faire quoi, avec quelles données

- L’observabilité : chaque décision et chaque appel d’outil est tracé

Le protocole MCP joue un rôle clé dans cette couche d’intégration en standardisant la communication entre le LLM et ses outils. C’est la même logique que celle du guide complet de l’automatisation IA : la valeur n’est pas dans le modèle, elle est dans l’orchestration autour du modèle.

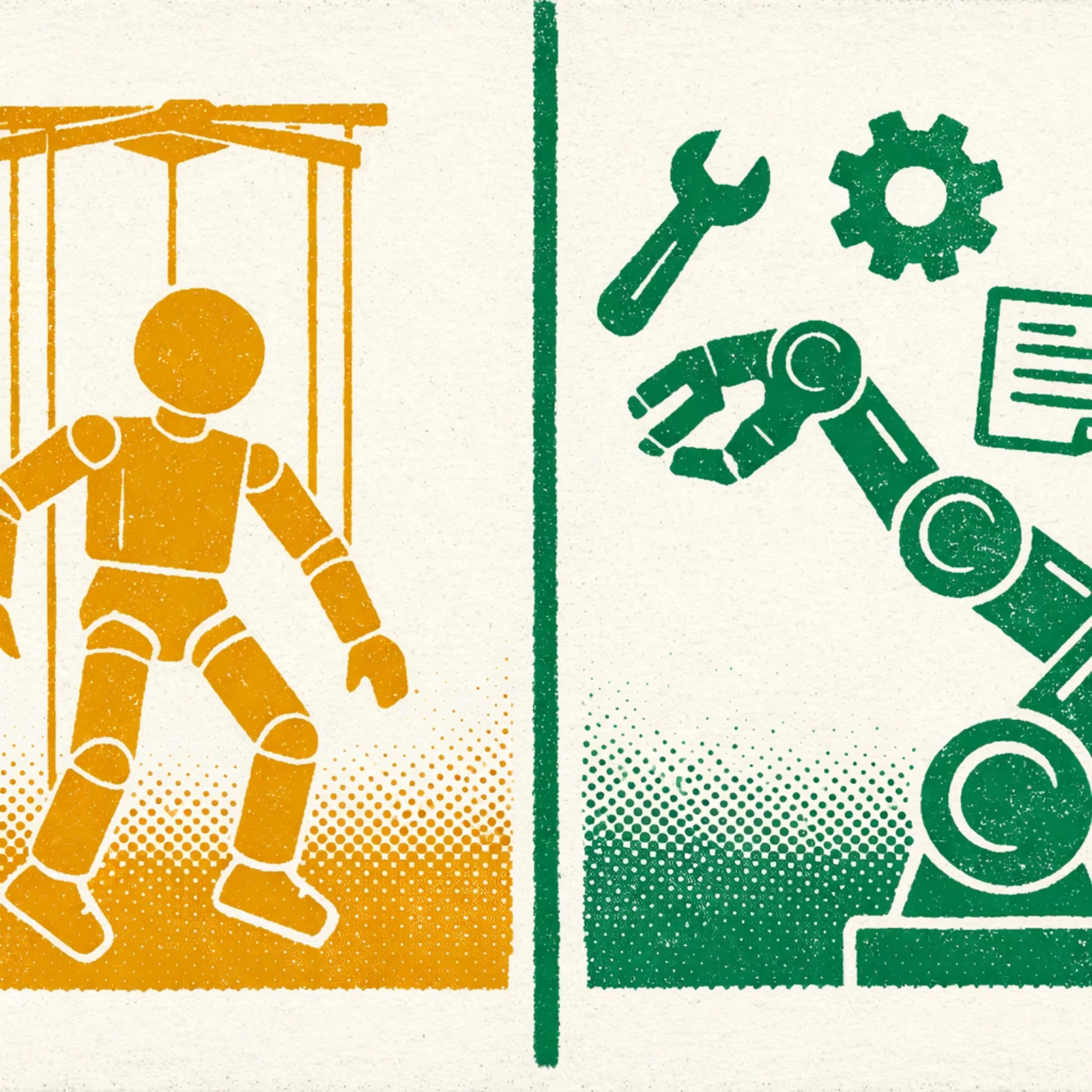

Cause 4 : l’agent washing, le faux problème devenu vrai problème

L’agent washing est le phénomène le plus insidieux du marché de l’IA en 2026. Il consiste à rebaptiser des chatbots, des outils RPA ou des workflows d’automatisation en « agents IA » pour justifier des tarifs premium.

Selon Gartner, seulement environ 130 fournisseurs sur les milliers qui revendiquent des capacités agentiques livrent de véritables systèmes autonomes. Cela signifie qu’environ 95 % des produits commercialisés comme « agents IA » n’en sont pas.

Comment distinguer un vrai agent d’une automatisation rebaptisée

| Critère | Vrai agent IA | Automatisation rebaptisée |

|---|---|---|

| Poursuite d’objectif | Décompose un objectif en sous-tâches de manière autonome | Nécessite une intervention humaine à chaque étape |

| Planification | Sélectionne dynamiquement le chemin d’exécution selon le contexte | Suit toujours la même séquence, quelles que soient les données |

| Utilisation d’outils | Interagit avec 5 à 10+ systèmes externes selon les besoins | Limité à des intégrations préconfigurées |

| Gestion des erreurs | Réessaie avec des paramètres alternatifs ou escalade avec un diagnostic | Erreurs génériques, crashes silencieux |

| Mémoire | Maintient le contexte entre les interactions | Traite chaque interaction comme isolée |

L’impact financier

Un vrai agent IA coûte entre 0,30 et 8 dollars par tâche. Une automatisation classique coûte moins de 0,001 dollar. Quand un fournisseur vous facture le prix d’un agent pour une automatisation, vous payez 300 à 8 000 fois le prix réel de la solution.

Les organisations qui tombent dans le piège de l’agent washing sous-estiment les coûts de 40 à 60 %, et certaines connaissent des dépassements de budget de 10x.

La solution

Avant d’investir, appliquez le test en 5 questions pour détecter l’agent washing :

- Le système poursuit-il un objectif de manière autonome ? S’il faut relancer à chaque étape, ce n’est pas un agent.

- La planification est-elle dynamique ? Si le chemin d’exécution est toujours le même, c’est un workflow, pas un agent.

- L’agent utilise-t-il des outils de manière autonome ? S’il est limité à des intégrations préconfigurées, c’est du RPA rebaptisé.

- Comment gère-t-il les erreurs ? Un vrai agent adapte sa stratégie. Un faux agent plante.

- Y a-t-il une mémoire entre les interactions ? Sans contexte persistant, il n’y a pas d’agentivité.

Exigez une démonstration sur vos propres données et cas limites, pas une démo préparée à l’avance.

Cause 5 : le manque de compétences et de structure opérationnelle

La dernière cause d’échec est la plus discrète, mais peut-être la plus déterminante.

Seulement 17 % des entreprises disposent d’une gouvernance formelle pour leurs projets IA. Or, celles qui en ont déploient des agents avec une fréquence et un taux de réussite nettement supérieurs.

Le problème concret

La plupart des entreprises traitent le déploiement d’un agent IA comme un projet informatique classique. Mais un agent IA en production nécessite :

- Du monitoring continu : un agent peut dériver dans ses réponses sans signal d’alerte

- Des évaluations régulières : les performances d’un agent se dégradent avec le temps si les données évoluent

- Un processus d’incident : quand un agent prend une mauvaise décision, qui intervient et comment ?

L’initiative de normalisation des agents IA lancée par le NIST en février 2026 confirme cette lacune : l’industrie manque de standards pour la sécurité, l’authentification et l’identité des agents.

La solution

Les organisations qui réussissent le déploiement d’agents IA en production nomment une équipe operations IA avant de sortir du pilote. Cette équipe possède trois responsabilités :

- Monitoring de production : surveillance des décisions de l’agent, détection des dérives

- Évaluation continue : tests réguliers sur des jeux de données de référence

- Réponse aux incidents : protocole clair quand l’agent dysfonctionne

Curtis Northcutt, fondateur de Cleanlab, estime que les vrais agents IA opérationnels à grande échelle ne se généraliseront probablement pas avant début 2027. D’ici là, la maturité opérationnelle des équipes sera le facteur différenciateur.

Ce que font les 12 % qui réussissent

Les entreprises qui déploient des agents IA en production avec succès ne sont pas celles qui choisissent le meilleur modèle. Ce sont celles qui investissent dans l’infrastructure autour du modèle.

Voici les quatre pratiques qui les distinguent :

| Pratique | Détail |

|---|---|

| Évaluation structurée des risques | Analyse des modes de défaillance avant le développement - réduit le taux d’échec sous 15 % |

| Périmètre contrôlé | Un cas d’usage précis, des résultats mesurables, des intégrations limitées |

| Équipe operations dédiée | Monitoring, évaluation et incident response en place avant la mise en production |

| Investissement dans l’observabilité | Plus de budget sur le monitoring que sur le prompt engineering |

Le point commun : elles traitent l’agent IA comme un système de production, pas comme un projet d’innovation.

Pour ceux qui débutent, le guide pour créer un premier agent IA avec n8n pose les bonnes bases. Mais l’article que vous lisez montre que la construction de l’agent n’est que 20 % du travail. Les 80 % restants, c’est l’operations, la gouvernance et la qualité des données.

Mon avis : l’ère des agents IA viendra, mais pas comme ça

Après avoir analysé ces données et observé les retours terrain, mon verdict est clair : le problème n’est pas que les agents IA ne fonctionnent pas. Le problème, c’est que la majorité des projets essaient de courir avant de savoir marcher.

Les organisations qui réussissent ne sont pas les plus innovantes. Ce sont les plus disciplinées : données préparées, périmètre étroit, équipe operations en place, fournisseurs évalués sans complaisance.

Si vous envisagez un projet d’agent IA en 2026, commencez par trois questions :

- Avez-vous vraiment besoin d’un agent ? Une automatisation classique bien construite résout 80 % des cas d’usage à une fraction du coût.

- Vos données sont-elles prêtes ? Si vous ne pouvez pas répondre « oui » avec des preuves, l’agent échouera.

- Avez-vous l’équipe pour opérer l’agent en production ? Sans monitoring et gouvernance, même le meilleur agent dérive en quelques semaines.

L’ère des agents IA opérationnels arrivera. Mais elle appartiendra aux organisations qui auront investi dans les fondations, pas dans le battage médiatique.

FAQ

Quel est le taux d’échec des projets d’agents IA en 2026 ?

Selon l’étude RAND Corporation de 2024, plus de 80 % des projets IA n’atteignent pas un déploiement en production significatif. Pour les agents IA spécifiquement, 88 % des pilotes ne dépassent jamais le stade du POC (IDC/Lenovo), et seulement 14 % des entreprises ont déployé un agent à l’échelle organisationnelle en mars 2026.

C’est quoi l’agent washing en intelligence artificielle ?

L’agent washing consiste à rebaptiser des chatbots, des outils RPA ou des workflows d’automatisation classiques en « agents IA » pour justifier des prix premium. Selon Gartner, seulement 130 fournisseurs sur des milliers offrent de véritables capacités agentiques autonomes - environ 95 % des produits présentés comme agents IA ne sont pas de vrais agents.

Quelle est la différence entre un vrai agent IA et une automatisation rebaptisée ?

Un vrai agent IA poursuit un objectif de manière autonome, planifie dynamiquement ses étapes, utilise des outils externes, gère les erreurs avec des stratégies alternatives et maintient un contexte entre les interactions. Une automatisation rebaptisée suit un chemin fixe, nécessite une intervention humaine à chaque étape et ne s’adapte pas au contexte.

Pourquoi la plupart des agents IA échouent en production ?

Les cinq causes principales sont : l’absence de stratégie data et de gouvernance, le syndrome du POC permanent (innovation theater), les problèmes d’intégration technique (Dumb RAG, connecteurs fragiles), l’agent washing qui masque des automatisations classiques, et le manque de compétences et de structures opérationnelles dédiées.

Comment éviter l’échec d’un projet d’agent IA ?

Commencez par un cas d’usage précis avec des résultats mesurables, pas par la technologie. Préparez vos données avant de connecter un LLM. Construisez une couche d’intégration dédiée. Évaluez vos fournisseurs avec le test en 5 questions pour détecter l’agent washing. Et nommez une équipe operations IA avant de sortir du pilote.

Les vrais agents IA opérationnels existent-ils déjà en 2026 ?

Oui, mais ils sont rares. Selon Curtis Northcutt (Cleanlab), les agents IA véritablement opérationnels à grande échelle ne se généraliseront probablement pas avant début 2027. Les cas de succès partagent un point commun : un périmètre étroit, des données préparées et une équipe operations dédiée.

Combien coûte un vrai agent IA par rapport à une automatisation classique ?

Un vrai agent IA coûte entre 0,30 et 8 dollars par tâche exécutée, contre moins de 0,001 dollar pour une automatisation classique. Les organisations sous-estiment les coûts de 40 à 60 %, et certaines connaissent des dépassements de budget de 10x.

Existe-t-il des standards pour les agents IA en 2026 ?

En février 2026, le NIST a lancé l’AI Agent Standards Initiative pour établir des normes de sécurité, d’authentification et d’interopérabilité des agents IA. L’initiative repose sur trois piliers : standards techniques, protocoles open source et recherche sur la sécurité des agents. Avant cette initiative, l’industrie manquait de cadre formel pour le déploiement d’agents autonomes.

Questions fréquentes

Quel est le taux d'échec des projets d'agents IA en 2026 ?

Selon l'étude RAND Corporation de 2024, plus de 80 % des projets IA n'atteignent pas un déploiement en production significatif. Pour les agents IA spécifiquement, les chiffres sont encore plus sévères : 88 % des pilotes ne dépassent jamais le stade du POC selon IDC et Lenovo, et seulement 14 % des entreprises ont réussi à déployer un agent à l'échelle organisationnelle en mars 2026.

C'est quoi l'agent washing en intelligence artificielle ?

L'agent washing consiste à rebaptiser des chatbots, des outils RPA ou des workflows d'automatisation classiques en « agents IA » pour justifier des prix premium. Selon Gartner, seulement 130 fournisseurs sur des milliers offrent de véritables capacités agentiques autonomes. Environ 95 % des produits présentés comme agents IA ne sont pas de vrais agents.

Quelle est la différence entre un vrai agent IA et une automatisation rebaptisée ?

Un vrai agent IA poursuit un objectif de manière autonome, planifie dynamiquement ses étapes, utilise des outils externes, gère les erreurs avec des stratégies alternatives et maintient un contexte entre les interactions. Une automatisation rebaptisée suit un chemin fixe, nécessite une intervention humaine à chaque étape et ne s'adapte pas au contexte.

Pourquoi la plupart des agents IA échouent en production ?

Les cinq causes principales sont : l'absence de stratégie data et de gouvernance, le syndrome du POC permanent (innovation theater), les problèmes d'intégration technique (Dumb RAG, connecteurs fragiles), l'agent washing qui masque des automatisations classiques, et le manque de compétences et de structures opérationnelles dédiées.

Comment éviter l'échec d'un projet d'agent IA ?

Commencez par un cas d'usage précis avec des résultats mesurables, pas par la technologie. Préparez vos données avant de connecter un LLM. Construisez une couche d'intégration dédiée (mémoire, I/O, permissions, observabilité). Évaluez vos fournisseurs avec le test en 5 questions pour détecter l'agent washing. Et nommez une équipe operations IA avant de sortir du pilote.

Les vrais agents IA opérationnels existent-ils déjà en 2026 ?

Oui, mais ils sont rares. Selon Curtis Northcutt (Cleanlab), les agents IA véritablement opérationnels à grande échelle ne se généraliseront probablement pas avant début 2027. En mars 2026, seules 14 % des entreprises ont réussi à déployer un agent en production à l'échelle organisationnelle. Les cas de succès partagent un point commun : un périmètre étroit, des données préparées et une équipe operations dédiée.

Combien coûte un vrai agent IA par rapport à une automatisation classique ?

Un vrai agent IA coûte entre 0,30 et 8 dollars par tâche exécutée, contre moins de 0,001 dollar pour une solution d'automatisation classique. Les organisations sous-estiment systématiquement les coûts de 40 à 60 %, et certaines connaissent des dépassements de budget de 10x. Un pilote abandonné avec cinq ingénieurs seniors pendant trois mois représente plus de 500 000 dollars en salaires.

Existe-t-il des standards pour les agents IA en 2026 ?

En février 2026, le NIST (National Institute of Standards and Technology) a lancé l'AI Agent Standards Initiative. Cette initiative vise à établir des normes pour la sécurité, l'authentification et l'interopérabilité des agents IA. Elle se concentre sur trois piliers : le développement de standards techniques, les protocoles open source pour agents, et la recherche sur la sécurité et l'identité des agents. Avant cette initiative, l'industrie manquait de cadre formel pour encadrer le déploiement des agents autonomes.